Ricardo Haye (*)

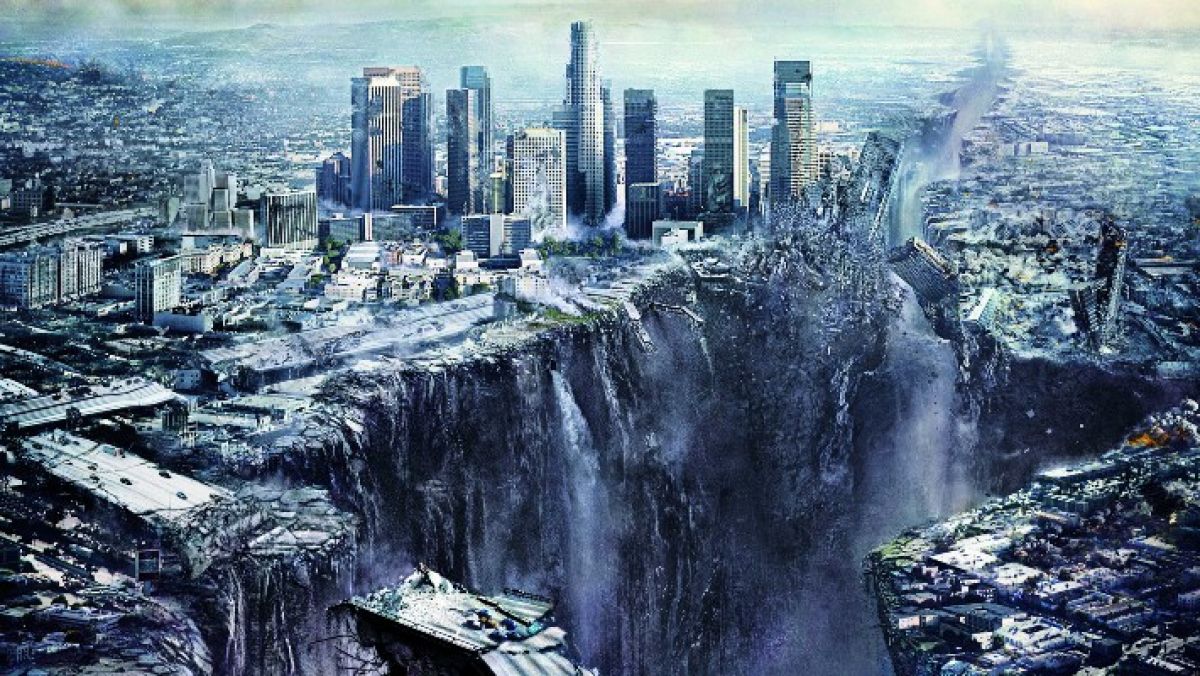

¿Cuántas veces vimos en el cine o en la televisión imágenes de calamidades apocalípticas que acaban con el mundo?

Ese gesto narrativo sentó sus bases en causas naturales y también en acciones de la humanidad. Ante nuestra memoria se suceden, en rápido desfile, meteoritos u otros cuerpos celestes en ruta de colisión e imposibles de desviar, el cambio climático y el calentamiento global, erupciones volcánicas, distorsiones en el campo magnético de la Tierra, el envejecimiento del Sol, invasiones alienígenas, inteligencias artificiales desbocadas, hambrunas tremendas por la infertilidad de la tierra y la muerte de los animales, incapacidad humana para la reproducción, mutaciones genéticas variadas, zombies, etcétera.

Las distintas etiquetas de la cultura audiovisual a veces no resultan suficientes para catalogar todas las realizaciones, que transitan por la ciencia-ficción, la aventura, el terror, el gore o los dramas humanos y que genéricamente, pero también con imprecisión, solemos llamar “cine catástrofe”.

La novedad es que ahora filosofía y matemática evalúan hipótesis similares para el futuro inmediato. Según Toby Ord, investigador australiano radicado en Londres, existe una posibilidad entre seis de que la humanidad desaparezca en el transcurso de este siglo.

Las causas posibles que dan sustento a ese enunciado señalan que los riesgos emergentes de la acción humana son mayores a los que provienen de causas naturales.

En busca de morigerar el impacto de su estimación, este filósofo del Instituto para el Futuro de la Humanidad de la Universidad de Oxford y asesor de la Organización Mundial de la Salud destacó que de la predicción también se desprende lo contrario: “Que hay cinco posibilidades entre seis de que sobrevivamos como «especie 1»”. Tal vez con el mismo criterio de evitar crudezas que generen pánico, elige hablar de colapso y no de armagedones tremebundos.

Más allá de las probabilidades que surgen a través de la aplicación de un modelo matemático, Ord dice que no le teme tanto a un virus como a las amenazas potenciales de grupos terroristas que diseñen armas biológicas, una tecnología que, a diferencia de las armas nucleares, cada vez es más accesible y difícil de rastrear. Para el pensador la inteligencia artificial es más peligrosa que las pandemias, pues, al igual que las armas biológicas, puede suponer en los próximos 50 años riesgos nuevos que aún desconocemos y en cuya prevención apenas estamos invirtiendo. “La humanidad –apunta ácidamente– gasta más cada año en helados que en que prevenir que las nuevas tecnologías no nos destruyan”.

Aunque no compartimos en absoluto su cuestionamiento a la degustación de helados, ahora que hemos incorporado a nuestra vida un equipo de parlantes inteligentes, su análisis acerca de la inteligencia artificial nos resulta inquietante, sobre todo cuando le atribuye una posibilidad entre diez de acabar con la humanidad. Aparentemente ni las tres leyes de la robótica concebidas por Isaac Asimov podrán resguardarnos definitivamente, y la mayor preocupación viene dada porque todavía no existe conciencia pública acerca de sus riesgos. Respecto de las responsabilidades políticas y sociales en esta circunstancia, solo nos queda reiterar aquel viejo proverbio que señala: “A quien le quepa el sayo, que se lo ponga”.

Y, mientras tanto, no podemos dejar de preguntarnos de qué sirvieron tantos millones invertidos en productos audiovisuales que retrataron devastaciones y tantísimas horas ocupadas en observarlos. ¿Qué aprendizajes obtuvimos de ellos?

La humanidad, que alguna vez se deleitó con la fabulación de Tomás Moro respecto de un territorio utópico, inició hace siglos una deriva de sus expectativas hacia conceptos menos esperanzadores. La distopía tomó el relevo y se aupó en cierta impronta de determinismo tecnológico que fue virando desde enfoques “tecno-optimistas” hasta perspectivas donde el “tecno-pesimismo” es quien preside las situaciones.

Ord opina que científicos y gobiernos deberían estar trabajando en el desarrollo de protocolos de seguridad equivalentes a los que el siglo pasado se elaboraron para conjurar el riesgo nuclear.

A su juicio, la gran dificultad que enfrentamos es que nuestros 200.000 años de existencia aún no permiten que superemos la etapa de la adolescencia… y los adolescentes –sostiene– no son buenos ordenando las prioridades. Por eso actuamos de forma tremendamente imprudente con el futuro, pensando apenas en nuestra vida de las próximas horas y no en los riesgos que afronta la continuidad de la sociedad humana y que afectan o limitan su potencial de evolución.

La prédica de Ord incluye un sencillo consejo: “No elegir políticos que actúen como adolescentes sería un buen comienzo para garantizar el futuro de la humanidad”. Las experiencias vigentes de Donald Trump y Jair Bolsonaro podrían incluso hacernos pensar que algunos dirigentes todavía no superaron su etapa infantil.

<El precipicio. Riesgo existencial y el futuro de la humanidad< es la obra en la que Toby Ord expresa que salvaguardar el futuro de la humanidad es uno de los problemas morales más importantes de nuestro tiempo.

Las opiniones de Ord han sido generosamente difundidas por numerosos medios electrónicos, entre ellos el portal español El Confidencial o el sitio Mil Patagonias (https://www.milpatagonias.com)

(*) Docente-investigador de la Universidad Nacional del Comahue. De vaconfirma.com.ar